先日、大学の講義で教授からこんな助言がありました。「AIはいくつかの種類を使って、答えを検討してみると良い」。生成AIが提供する情報を過信しないよう注意が必要だが、有効に活用すべきということです。

昨年、受講していた講義では、生成AIを使って課題をこなすことを批判する声もありました。それからわずか一年足らずで、AIを活用して共存しようという機運が高まっているように感じます。

AIは急速に私たちの社会に浸透しているといえるでしょう。筆者自身、生成AIを身近に感じながら、過信せず上手く利用しなければと日々思っています。しかし、便利だという利点ばかりが先行してしまいがちです。

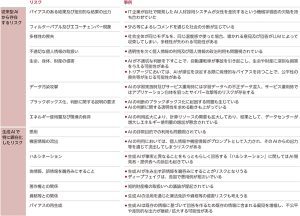

では、AIが普及することによる問題点とは何でしょうか。改めて考えてみようと思います。2024年4月に総務省・経済産業省が策定した「AI事業者ガイドライン(第1.0版)」では、AIによって顕在化したリスクを例示しています。

(AI事業者ガイドライン(第1.0版) 総務省ホームページより)

このガイドラインでは、AI全般に以前から存在するリスクだけでなく、生成AIによって顕在化した課題も挙げられています。

これまでのAIが抱える問題は大きく以下の通りです。

・AIが提示する情報によってバイアスが強まる

・アルゴリズムがネット利用者個人の検索履歴やクリック履歴を分析し学習することで見たい情報が 優先され、自身の考え方や価値観が偏るフィルターバブル現象が加速する

・AIの利用拡大に伴いエネルギー使用量が増加することで環境に負荷がかかる

ガイドラインを見ると、これにとどまらず様々な課題があると分かります。また、従来のAIに加え生成AIが普及することに伴う課題も散見されます。生成AIによって虚偽の情報が真実のように伝えられるハルシネーションの課題など、どれも無視出来ないことばかりです。

AIによる課題は多岐に渡ります。フィルターバブル現象やハルシネーションに対しては、AIの特性を理解し利用者それぞれが批判的視点を持つことが重要だと感じました。一方、個人の意識では改善出来ない課題も多くあるといえるでしょう。

環境問題まで引き起こしかねないAIの副作用は大きな社会問題だといえます。そんなAIと向き合うため、いまELSI(エルシー)が強調されています。

ELSI(エルシー)

倫理的(エシカル)、法的(リーガル)、社会的課題(ソーシャル・イシューズ)と、その解決策を示す言葉。

(3月25日付 朝日新聞朝刊「AI時代、求められる倫理観 ELSI大学サミット」より)

Ethical, Legal and Social Issuesの頭文字を取った言葉で、新たな科学技術を研究開発し、社会に実装する際に生じる、技術的分野以外のあらゆる課題を含みます。ゲノム解析技術で生じた課題に対して生まれた言葉のようですが、現在では幅広い文脈で使われています。

急速に発達するAI。社会課題をはじめ問題は山積みです。利用者個人がAIの特性を理解し、リテラシーを身につけながら活用していくことが大切だと考えます。同時に、倫理や法律の観点からAIと向き合い、課題解決をめざす姿勢が重要な役割を担っています。今後、ELSIをめぐる議論が活発になることを期待します。

参考記事:

3月27日付 朝日新聞朝刊「AI時代、求められる倫理観 ELSI大学サミット」

5月7日付 朝日新聞朝刊(総合)「オープンAI、営利化断念 「安全軽視」批判高まり NPO継続」

参考資料:

大阪大学 社会技術共創研究センター ELSIセンター 「ELSIとは」